Une AIPD impeccable ne dispense pas d’une FRIA. C’est l’une des confusions les plus fréquentes — et les plus coûteuses — dans la mise en conformité au règlement (UE) 2024/1689 sur l’intelligence artificielle (« AI Act » ou « RIA »). Bien qu’elles partagent une logique d’analyse d’impact préalable, l’AIPD (analyse d’impact relative à la protection des données, art. 35 RGPD) et la FRIA (Fundamental Rights Impact Assessment, art. 27 RIA) relèvent de deux régimes juridiques distincts, avec des champs d’application, des contenus et des destinataires différents.

Pour un DPO ou un juriste interne, l’enjeu n’est pas théorique : une organisation peut très bien avoir documenté une AIPD irréprochable et se trouver en défaut sur la FRIA, ou inversement déclencher des FRIA inutiles par excès de prudence. Cet article détaille les sept différences à maîtriser, les cas où les deux obligations coexistent, et la méthode pour construire une cartographie cohérente sans dupliquer le travail.

Inscrivez-vous à notre newsletter et recevez immédiatement votre checklist de conformité AI Act complète — 47 actions concrètes réparties sur 17 onglets, prête à l’emploi.

En bonus, vous recevrez chaque mois nos analyses et décryptages sur l’évolution de la réglementation IA, les nouvelles recommandations de la CNIL et les bonnes pratiques de conformité.

Notre newsletter est fondée sur votre consentement à la recevoir. Désinscrivez vous à tout moment en un clic. En savoir plus

Pourquoi la confusion AIPD/FRIA est si fréquente

Trois facteurs alimentent l’amalgame. D’abord, le vocabulaire : « analyse d’impact » désigne un genre documentaire que les praticiens connaissent par le RGPD, et la tentation est forte de le décliner mécaniquement à l’IA. Ensuite, le chevauchement partiel des champs : un système d’IA à haut risque traite presque toujours des données personnelles, ce qui place de facto le déployeur dans le périmètre des deux obligations. Enfin, l’absence de doctrine consolidée : l’article 27 du RIA n’entrera en application que le 2 août 2026, et les lignes directrices attendues de l’AI Office et de la Commission européenne ne sont pas encore publiées à la date de rédaction de cet article.

Résultat : beaucoup d’organisations tentent de fusionner les deux exercices dans un document unique, ce qui est juridiquement insuffisant. Les distinctions ci-dessous expliquent pourquoi.

AIPD et FRIA : 7 différences clés

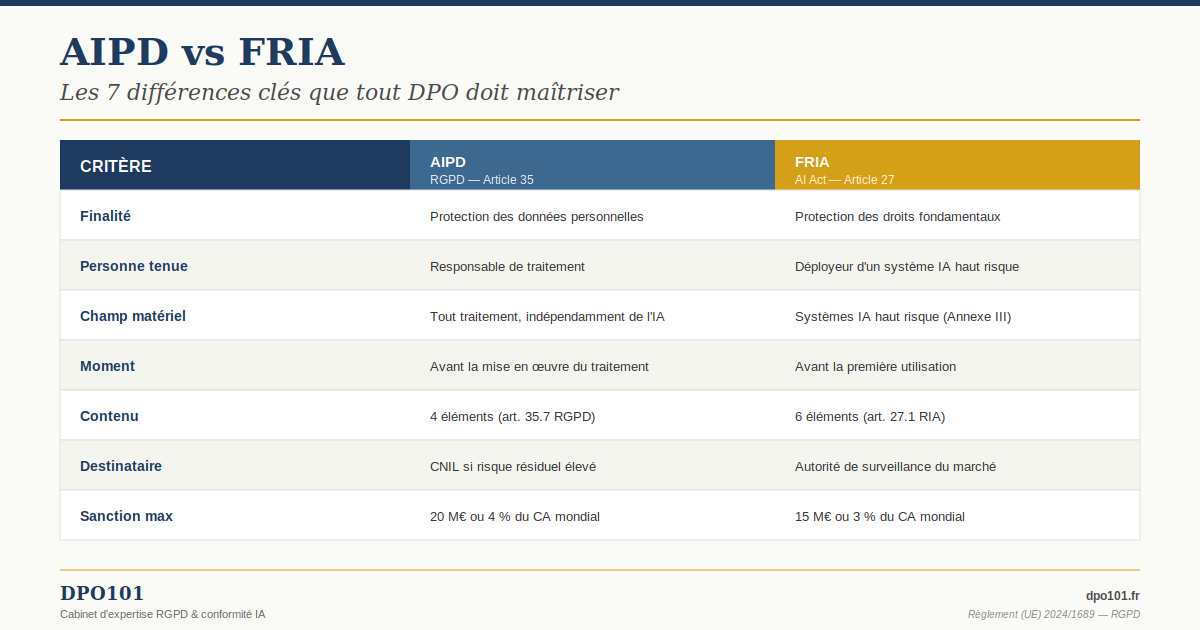

| Critère | AIPD (RGPD Art. 35) | FRIA (RIA Art. 27) |

|---|---|---|

| Base légale | Article 35 RGPD | Article 27 du règlement (UE) 2024/1689 |

| Finalité | Protection des données à caractère personnel | Protection des droits fondamentaux (dignité, non-discrimination, liberté d’expression…) |

| Personne tenue | Responsable de traitement | Déployeur d’un système d’IA à haut risque |

| Déclencheur | Traitement susceptible d’engendrer un risque élevé pour les droits et libertés | Déploiement d’un système haut risque par certaines catégories d’acteurs (art. 27.1) |

| Champ matériel | Tout traitement, indépendamment de l’IA | Systèmes d’IA à haut risque visés à l’Annexe III |

| Moment | Avant la mise en œuvre du traitement | Avant la première utilisation du système |

| Contenu | 4 éléments (art. 35.7 RGPD) | 6 éléments (art. 27.1 RIA) |

| Destinataire | CNIL si risque résiduel élevé (consultation préalable, art. 36) | Autorité de surveillance du marché, notification systématique des résultats |

| Sanction maximale | 20 M€ ou 4 % du chiffre d’affaires mondial | 15 M€ ou 3 % du chiffre d’affaires mondial |

Quatre de ces différences méritent un développement particulier parce qu’elles sont contre-intuitives ou systématiquement mal traitées.

1. Une finalité fondamentalement différente

L’AIPD vise à protéger les personnes contre les risques liés au traitement de leurs données personnelles : confidentialité, intégrité, exactitude, conservation. La FRIA vise un objet beaucoup plus large — l’ensemble des droits fondamentaux protégés par la Charte des droits fondamentaux de l’Union européenne. Cela inclut la non-discrimination, la liberté d’expression, le droit à un recours effectif, la dignité, la présomption d’innocence, ou encore la liberté de réunion. Le considérant 96 du RIA est explicite sur ce point : la FRIA est conçue comme un complément, non comme un substitut à l’AIPD.

Concrètement : un système de scoring de crédit peut respecter scrupuleusement le RGPD (base légale, minimisation, transparence) tout en produisant des effets discriminatoires indirects sur certains profils. Ce risque relève de la FRIA, pas de l’AIPD.

2. La personne tenue n’est pas la même

L’AIPD pèse sur le responsable de traitement au sens du RGPD. La FRIA pèse sur le déployeur au sens de l’article 3.4 du RIA, c’est-à-dire « toute personne physique ou morale, autorité publique, agence ou autre organisme utilisant un système d’IA sous sa propre autorité ».

Ces deux qualités peuvent coïncider, mais pas toujours. Une filiale qui utilise un système d’IA fourni par sa maison-mère peut être déployeur sans être responsable de traitement principal. Inversement, un sous-traitant RGPD qui se contenterait d’héberger des données ne serait pas déployeur s’il ne met pas le système en œuvre sous sa propre autorité. La cartographie des rôles doit donc être refaite spécifiquement pour le RIA.

3. Le champ matériel est strictement borné côté FRIA

L’AIPD s’applique à tout traitement présentant un risque élevé, qu’il fasse intervenir de l’IA ou non. La FRIA, à l’inverse, ne se déclenche que pour les systèmes d’IA qualifiés de haut risque au sens de l’article 6 et de l’Annexe III du RIA — et uniquement pour certaines sous-catégories de déployeurs (voir section suivante).

Ce point a une conséquence pratique majeure : pour un outil interne d’analyse RH n’utilisant pas d’IA, l’AIPD peut être obligatoire mais la FRIA ne l’est pas. Pour un système d’IA d’aide à la décision médicale, les deux peuvent coexister. Pour un chatbot de service client à risque limité, ni l’une ni l’autre n’est requise.

4. Une notification systématique, pas une consultation conditionnelle

C’est l’une des différences les plus structurantes. Sous le RGPD, la consultation de la CNIL n’intervient qu’en cas de risque résiduel élevé non maîtrisé par les mesures envisagées (art. 36 RGPD). La grande majorité des AIPD ne sont jamais transmises à l’autorité.

Sous le RIA, la notification des résultats de la FRIA à l’autorité de surveillance du marché est systématique (art. 27.3). Le déployeur transmet les résultats via un formulaire-type qui sera publié par l’AI Office. Cette différence change le standard de qualité documentaire attendu : la FRIA est destinée à être lue par le régulateur dès l’origine, pas seulement en cas de contrôle.

Quand les deux obligations coexistent (Art. 27.4)

L’article 27.4 du RIA prévoit explicitement qu’une FRIA peut s’appuyer sur l’AIPD lorsque les deux obligations coexistent. Si vous avez déjà réalisé une AIPD couvrant le traitement alimenté par le système d’IA, vous pouvez compléter cette AIPD par les éléments manquants de la FRIA plutôt que produire un document entièrement distinct.

Attention toutefois : cette mutualisation est à sens unique. L’AIPD ne couvre jamais intégralement une FRIA, parce que son champ matériel se limite aux données personnelles. Les atteintes à la non-discrimination dans l’accès à un service, à la liberté d’expression, ou à la dignité ne relèvent de l’AIPD que de manière indirecte. Dans tous les cas, la FRIA reste obligatoire en tant que telle : on ne la remplace pas par l’AIPD, on mutualise la production documentaire.

En pratique, deux modèles d’organisation se dessinent :

- Modèle intégré : un document unique avec deux parties clairement identifiées (partie AIPD soumise au DPO et à la CNIL, partie FRIA soumise au métier et à l’autorité de surveillance du marché). Avantage : cohérence et économie documentaire. Inconvénient : risque de confusion sur la base légale invoquée.

- Modèle parallèle : deux documents séparés, avec renvois croisés. Avantage : clarté juridique. Inconvénient : duplication du travail sur la description du système.

Pour les organisations matures sur la conformité RGPD, le modèle intégré est généralement préférable, à condition d’avoir une trame documentaire qui distingue rigoureusement les deux exercices.

Arbre de décision : quelle(s) analyse(s) devez-vous mener ?

Étape 1 — Y a-t-il traitement de données personnelles susceptible d’engendrer un risque élevé pour les droits et libertés ?

- Oui : AIPD obligatoire (art. 35 RGPD)

- Non : pas d’AIPD

Étape 2 — Le système est-il un système d’IA à haut risque au sens de l’article 6 et de l’Annexe III du RIA ?

- Non : ni FRIA ni obligations spécifiques de l’art. 26

- Oui : obligations générales du déployeur (art. 26 RIA), passez à l’étape 3

Étape 3 — Relevez-vous de l’une de ces quatre catégories visées à l’article 27.1 ?

- a) Organisme de droit public

- b) Entité privée fournissant un service public

- c) Déployeur d’un système d’évaluation de la solvabilité ou de scoring de crédit (Annexe III, point 5.b)

- d) Déployeur d’un système d’évaluation des risques et de tarification en assurance vie ou santé (Annexe III, point 5.c)

→ Oui : FRIA obligatoire (art. 27), en plus de l’AIPD le cas échéant

→ Non : pas de FRIA, mais l’art. 26 reste pleinement applicable

4 erreurs fréquentes à éviter

Erreur n°1 — Sur-application aux systèmes RH. Les systèmes d’IA d’aide au recrutement et de gestion de carrière relèvent de l’Annexe III point 4. À ce titre, ils déclenchent les obligations générales du déployeur (art. 26) et, s’ils traitent des données personnelles à risque élevé, une AIPD. Mais ils ne déclenchent pas la FRIA, sauf si l’employeur entre par ailleurs dans l’une des quatre catégories de l’article 27.1 (typiquement : un employeur public). La tentation de réaliser une FRIA « par précaution » sur tout système RH est compréhensible mais juridiquement infondée et créatrice d’inflation documentaire.

Erreur n°2 — Sous-application aux délégataires privés de service public. Beaucoup d’entités privées exerçant une mission de service public (transports urbains, distribution d’eau ou d’énergie, certains opérateurs de santé conventionnés, gestionnaires de logements sociaux) ne se perçoivent pas comme « déployeurs publics » et passent à côté de l’obligation. Le critère de l’article 27.1.b est fonctionnel, pas statutaire : peu importe la forme juridique, ce qui compte est la nature de la mission exercée.

Erreur n°3 — Fusionner les deux analyses dans un document indistinct. L’argument de l’économie documentaire est légitime, mais une FRIA qui ne distingue pas clairement sa base légale et son périmètre matériel de ceux de l’AIPD risque d’être considérée comme insuffisante par l’autorité de surveillance du marché. Mutualisez la description du système, mais dédoublez l’analyse de risques.

Erreur n°4 — Oublier la notification. Contrairement à l’AIPD, la FRIA doit être systématiquement notifiée à l’autorité de surveillance du marché via un formulaire dédié. Cette étape, souvent méconnue, est explicitement prévue par l’article 27.3 du RIA.

Calendrier et plan d’action

L’article 27 du RIA devient applicable le 2 août 2026, en même temps que la majorité des obligations pesant sur les systèmes haut risque de l’Annexe III. Pour les systèmes déjà déployés à cette date, une mise en conformité rétrospective est nécessaire. La FRIA doit également être mise à jour si l’un des éléments de l’analyse change matériellement.

Quatre actions à mener dès maintenant :

- Cartographier les systèmes d’IA déployés ou en projet et identifier ceux qui relèvent de l’Annexe III.

- Qualifier votre organisation au regard des quatre catégories de l’article 27.1 (cette qualification peut varier d’une entité à l’autre au sein d’un même groupe).

- Adapter votre trame d’AIPD pour intégrer une partie FRIA conforme aux six éléments de l’article 27.1, ou créer une trame FRIA dédiée.

- Anticiper le canal de notification auprès de l’autorité de surveillance du marché compétente (en France, la désignation est en cours de stabilisation).

Conclusion

L’AIPD et la FRIA partagent une logique d’analyse d’impact préalable, mais elles répondent à des objectifs juridiques distincts, mobilisent des acteurs différents et obéissent à des régimes de notification différents. Pour les DPO et juristes internes, trois réflexes structurants : ne pas confondre responsable de traitement et déployeur, ne pas sur-appliquer la FRIA aux cas non visés par l’article 27.1, et mutualiser sans fusionner la production documentaire.

La maîtrise de cette articulation est l’une des compétences clés de la conformité IA en 2026. Elle conditionne la cohérence de votre cartographie d’analyses d’impact — et, plus largement, la lisibilité de votre dispositif de gouvernance face aux régulateurs.

Sources : règlement (UE) 2024/1689 sur l’intelligence artificielle, articles 6, 26, 27 et Annexe III ; règlement (UE) 2016/679 (RGPD), articles 35 et 36 ; Charte des droits fondamentaux de l’Union européenne.