AI Act : le calendrier 2026 pour les PME et ETI (ce qui change vraiment)

L’AI Act est entré en vigueur en août 2024, mais c’est en 2026 que les choses sérieuses commencent. Vous utilisez un logiciel de tri de CV ? Un outil de scoring client ? Une IA pour évaluer vos collaborateurs ? Vous êtes concerné par les obligations « haut risque » qui arrivent dans quelques mois.

Voici ce que vous devez savoir — sans jargon juridique.

Quelles sont les échéances clés de l’AI Act ?

Le règlement européen s’applique de manière progressive de février 2025 à août 2027. Voici les dates à retenir :

Date | Ce qui entre en vigueur |

1er août 2024 | Entrée en vigueur officielle du règlement |

2 février 2025 | Interdiction des IA à risque inacceptable (scoring social, manipulation cognitive…) ✅ |

2 août 2025 | Obligations pour les modèles d’IA à usage général (GPAI) + désignation des autorités nationales ✅ |

2 août 2026 | Obligations complètes pour les systèmes d’IA à haut risque ⚠️ |

2 août 2027 | Extension aux IA intégrées dans des produits réglementés (dispositifs médicaux, jouets…) |

À noter : malgré les tentatives de lobbying pour repousser ces échéances, la Commission européenne a confirmé en juillet 2025 que le calendrier serait maintenu. La fenêtre pour se conformer est donc limitée.

Qu’est-ce qu’un système d’IA « à haut risque » ?

L’annexe III du règlement liste 8 domaines d’activité considérés comme à haut risque. Plusieurs concernent directement les PME et ETI :

- Emploi et gestion RH : tri automatisé de CV, évaluation des candidats, notation des performances, décisions d’affectation ou de licenciement

- Accès aux services financiers : scoring crédit, évaluation des risques pour l’octroi de prêts ou d’assurances

- Éducation et formation : systèmes d’évaluation, orientation, détection de triche

- Infrastructures critiques : gestion du trafic, réseaux d’énergie, eau

En clair : si votre outil d’IA influence des décisions qui impactent significativement la vie des personnes, il est probablement classé « haut risque ».

Fournisseur ou déployeur : quel est votre rôle ?

C’est la question à se poser en priorité. Le Règlement IA définit cinq rôles, mais deux concernent la majorité des entreprises :

Rôle | Définition | Vos obligations |

Fournisseur | Vous développez ou faites développer un système d’IA et le mettez sur le marché sous votre nom | Conformité technique complète, marquage CE, documentation exhaustive, surveillance post-marché |

Déployeur | Vous utilisez un système d’IA sous votre propre autorité (hors usage personnel) | Usage conforme aux instructions, surveillance humaine effective, contrôle qualité des données, conservation des journaux, formation du personnel |

Attention : la plupart des PME se pensent « simples utilisatrices » et donc peu concernées. C’est faux. En tant que déployeur, vous avez des responsabilités opérationnelles réelles, notamment si le système impacte vos salariés ou vos clients.

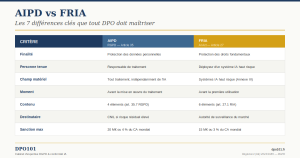

AI Act et RGPD : deux réglementations, une seule démarche

Une distinction fondamentale : le RGPD encadre les données personnelles, le RIA encadre les systèmes d’IA. Ces deux textes ne se substituent pas, ils s’additionnent.

L’intersection crée des zones de complexité, notamment lorsque vos systèmes d’IA traitent des données personnelles (ce qui est quasi systématique en RH, scoring, relation client…).

La bonne nouvelle : si vous êtes déjà en conformité RGPD, vous avez une base solide. Votre registre des traitements, vos PIA, votre documentation peuvent servir de point de départ pour la cartographie IA.

L’approche optimale consiste à développer une stratégie intégrée RIA/RGPD, en identifiant les synergies et en évitant les redondances.

Comment se mettre en conformité ? Les 6 étapes clés

- Gouvernance et pilotage

Désignez un responsable du projet « Conformité RIA ». Ce peut être le DPO, le RSSI, un juriste spécialisé ou un responsable d’une cellule IA dédiée. Ce pilote doit avoir un accès direct à la direction générale et une légitimité claire.

Constituez une équipe transversale réunissant IT, juridique, innovation et métiers utilisateurs d’IA.

- Cartographie des systèmes d’IA

C’est l’épine dorsale de la démarche. Identifiez exhaustivement tous les systèmes pouvant être qualifiés de systèmes d’IA selon l’article 3 du RIA : ceux développés en interne, ceux achetés sur étagère, ceux intégrés à des solutions tierces, ceux en projet.

Pour chaque système, documentez le niveau de risque selon les quatre catégories du Règlement : risque minimal, obligation de transparence, risque élevé, ou interdit.

- Qualification des rôles

Pour chaque système identifié, déterminez si vous êtes fournisseur, déployeur, importateur ou distributeur. Les obligations varient considérablement selon cette qualification.

- Plan d’actions RIA/RGPD intégré

Élaborez un plan qui imbrique les deux réglementations. La documentation technique requise par le RIA doit se conjuguer avec vos obligations documentaires RGPD. Définissez clairement le rôle du DPO dans les projets IA traitant des données personnelles.

- Gestion des risques

Mettez en place une analyse de risques systématique pour chaque projet IA, intégrant simultanément les exigences RIA et RGPD. Les systèmes à haut risque nécessitent des mesures de protection renforcées.

- Accountability et preuves

Maintenez une documentation complète et actualisée. Mettez en place des outils de contrôle, des tableaux de bord de suivi et un reporting vers la direction. La conformité doit pouvoir être démontrée à tout moment.

Quelles sanctions en cas de non-conformité ?

Le montant des amendes varie selon le niveau de risque :

- IA interdites : jusqu’à 35 millions d’euros ou 7% du CA mondial

- IA haut risque non conformes : jusqu’à 15 millions d’euros ou 3% du CA mondial

- Manquements de transparence : jusqu’à 7,5 millions d’euros ou 1% du CA mondial

La conformité RIA, c’est maintenant. Plus tard, ce sera plus cher et potentiellement trop tard.

Besoin d’un accompagnement pour cartographier vos usages IA et anticiper votre mise en conformité ? Contactez-nous.